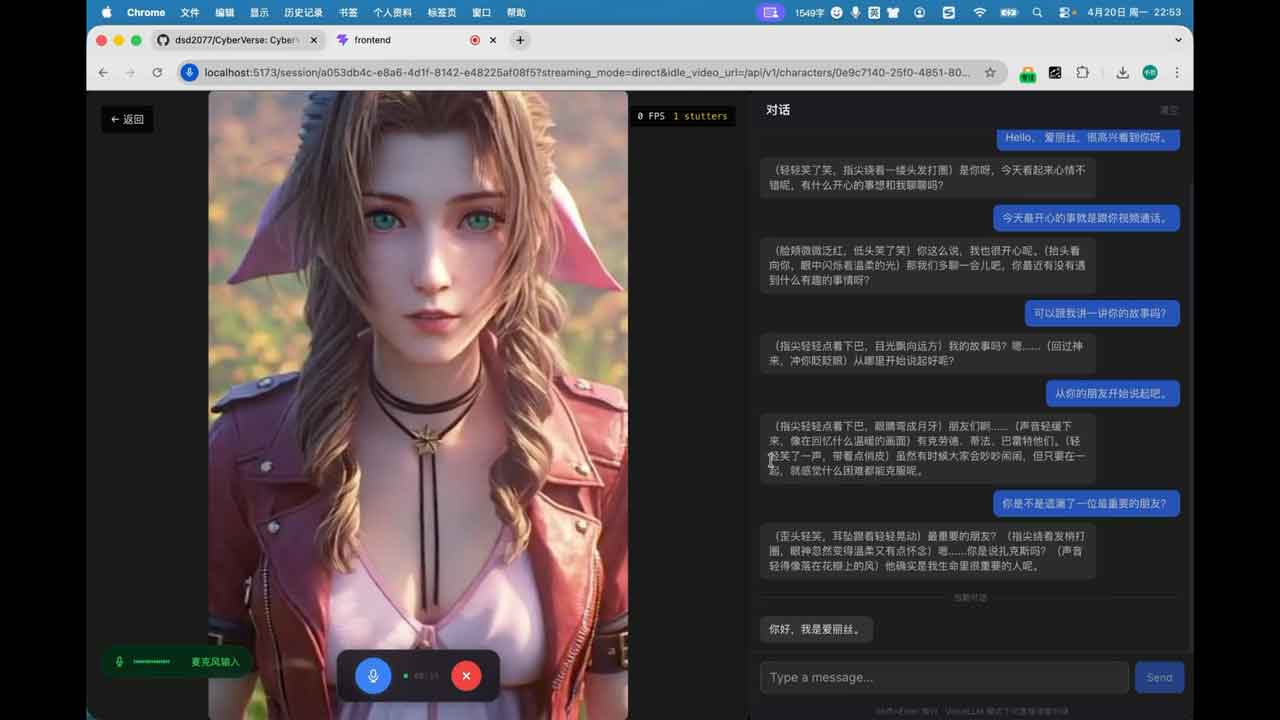

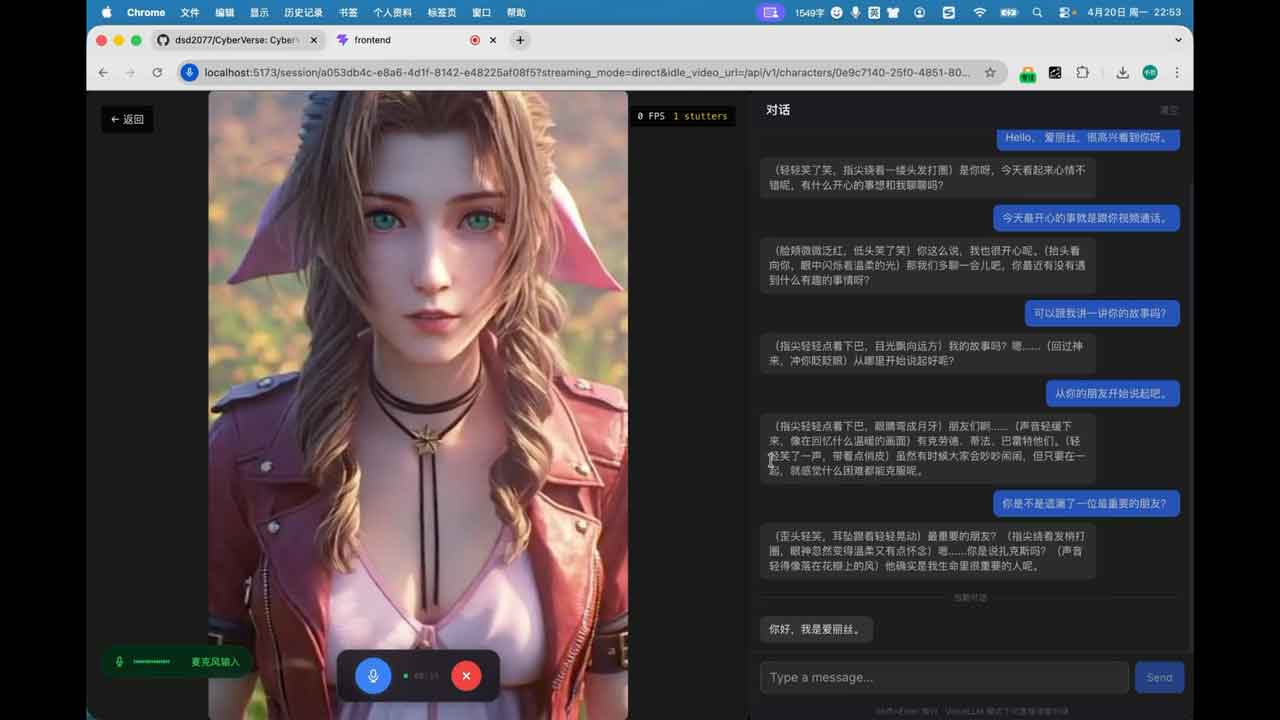

CyberVerse:打造实时视频通话AI角色,照片即成数字人

CyberVerse是一款开源的数字人Agent平台,通过整合大语言模型、语音识别、合成等技术与WebRTC视频流,实现照片生成实时视频通话AI角色,为开发者提供创新的多模态交互体验。

CyberVerse数字人Agent并非简单的聊天机器人,而是能够实现与AI数字人进行实时视频通话的开源框架。它将大语言模型、语音识别、合成、头像模型和WebRTC视频流等技术融合,将枯燥的文字聊天升级为带画面、有声音、口型同步的实时交互体验。

🌐 CyberVerse GitHub项目主页包含完整的源码、依赖清单与架构说明。

CyberVerse提供了一套可自托管的底层架构,但部分语音能力可能依赖第三方API服务,实际部署时需要根据模型、接口和许可条件进行配置。

它对显卡算力、环境配置的要求较高,目前更像是为开发者、AI产品团队和多模态交互研究者准备的技术原型。

CyberVerse数字人Agent:从聊天框到实时视频通话

CyberVerse的核心区别在于其实时流媒体通讯能力和组件化设计。工作流程大致为:上传照片生成数字人形象 → 对着麦克风说话 → 语音识别后交给大模型思考 → 生成文字并转换为语音 → 驱动数字人产生对应的面部动画和口型 → 最后通过WebRTC技术将音视频流实时推送到网页端。

部署情况:别光看开源免费,算力才是真正的成本

很多人看到“开源自托管”的第一反应是可以省钱。但如果你想把CyberVerse跑起来,真正的门槛在于较为复杂的开发环境,以及不低的GPU硬件成本。

根据官方硬件测试数据:使用参数量较小的FlashHead Lite面部模型,单张RTX 4090可以实时达到25+ FPS;但如果你想追求更好的画质,换上FlashHead Pro档位,单张RTX 4090的帧率会掉到约10.8 FPS,尚不能流畅互动。如果上更大参数的LiveAct 18B模型,甚至需要RTX PRO 6000级别的显卡。

适合谁用,不适合谁用

- ✅ 更适合:想做数字人客服、虚拟前台、AI视频助手等产品原型的工程团队;对WebRTC + LLM集成有学习需求、手里有算力资源的独立开发者。

- ❌ 不太适合:期望“一键安装包”的普通电脑用户;没有高端N卡的用户;想直接拿去当成熟商业客服系统上线的团队(项目暂无正式Release,仍需自行排坑)。

注意避开肖像、声音与伦理红线

最后提个醒,这类数字人技术很容易被联想到虚拟陪伴、人物复现等场景,但从合规角度看,这类用途往往伴随更高的肖像权、声音权与伦理风险。

免责声明:本文旨在对开源项目的架构与部署门槛进行客观技术评析。私有化部署可能涉及较高的硬件成本,项目部分功能仍在规划中,实际表现请以官方最新版本为准。本站不提供亦不储存任何侵权模型资源,商业化使用前请自行核对GPL-3.0及相关第三方模型许可协议。